Die Foren-SW läuft ohne erkennbare Probleme. Sollte doch etwas nicht funktionieren, bitte gerne hier jederzeit melden und wir kümmern uns zeitnah darum. Danke!

Grundlegende Fragen zur vSphere 6 Implementation

-

Christopher89

- Member

- Beiträge: 7

- Registriert: 07.08.2016, 13:09

Grundlegende Fragen zur vSphere 6 Implementation

Hallo zusammen,

ich bin neu hier im Forum und erhoffe mir ein paar erleuchtende Antworten von euch. Ich komme aus der Nähe von Frankfurt und studiere Informatik. In der Firma wo ich neben meinem Studium arbeite soll demnächst eine vSphere 6.0 Umgebung implementiert werden. Dazu habe ich ein paar konzeptionelle Fragen. Eigentlich bin ich mir sicher, dass ich die Antworten bereits kenne aber ich würde mir hier gerne eine Rückversicherung holen.

Offene Fragen:

1) Momentan haben gibt es hier Server mit Intel Xeon E5 v3 und Xeon E5 v4 Prozessoren. Kann man die beide zusammen in einem HA Cluster betreiben und den EVC Mode einfach auf „Hasswell“ stellen. Die Antwort dürfte theoretisch ja sein. Die Frage ist sollte man das auch in der Praxis tun? Es werden sehr oft VMs im Cluster migriert und kann es dann theoretisch Probleme geben wenn ständig VMs von einem Host mit einem Xeon E5 v3 Prozessor auf einem Xeon E5 v4 Host migriert werden und umgedreht?

2) Als externer Storage kommt iSCSI mit 10GBase-T zum Einsatz. Falls eine Netzwerkkarte ausfallen sollte ist ein Failover mit den 1000 Mbit onboard nics geplant. Reicht es dafür aus einfach einen neuen vSwitch zu erstellen und die 1000 Mbit failover nic mit IP vlan usw. zuzuweisen und dann läuft das failover automatisch über die 1000 Mbit nic falls die Netzwerkkarte mit den primären 10GBase-T Ports ausfällt? Dann müsste man also nur den 2. Failover vSwitch bei dem iSCSI Software Storage adapter hinzufügen? Wie definiert man dort, dass der Traffic primär über die 10Gbase-T Ports laufen soll damit die 1Gbase-T Ports nur beim Ausfall der 10Gbase-T Ports zum Einsatz kommen?

3) Internetanbindung: Ist es notwendig, dass das vCenter oder die ESXi Hosts eine aktive Internetverbindung benötigen? Bei Windows Servern ist dies ja z.B. notwendig um die Lizenzen zu aktivieren oder Windows Updates zu bekommen. Hintergrund ist, dass die Vorgabe hier lautet die vSphere Management Umgebung (vCenter, ESXi Hosts) in einem isolierten vlan ohne Internetverbindung zu betreiben. Also benötigt das vCenter/ESXi Nodes eine aktive Internetverbindung um z.B. die Lizenzen zu überpüfen bzw. auf dem Host/vCenter zu aktivieren? Oder wird dafür keine aktive Internetverbindung benötigt? Nach meinen Tests vermute ich, dass keine aktive Internetverbindung benötigt wird?

4) Bei ein paar Servern werden noch 10GBase-T Nics benötigt. Zur Auswahl stehen folgende kompatible Modelle: Intel Ethernet X540 DP 10GBASE-T Server Adapter oder QLogic 57810 Dual Port 10Gb Base-T Network Adapter. Gibt es da eine Empfehlung ob die QLogic oder Intel in der „Praxis“ besser ist? Auf der HCL scheint beides zertifiziert zu sein.

Über ein paar Antworten würde ich mich sehr freuen.

Viele Grüße

Christopher

ich bin neu hier im Forum und erhoffe mir ein paar erleuchtende Antworten von euch. Ich komme aus der Nähe von Frankfurt und studiere Informatik. In der Firma wo ich neben meinem Studium arbeite soll demnächst eine vSphere 6.0 Umgebung implementiert werden. Dazu habe ich ein paar konzeptionelle Fragen. Eigentlich bin ich mir sicher, dass ich die Antworten bereits kenne aber ich würde mir hier gerne eine Rückversicherung holen.

Offene Fragen:

1) Momentan haben gibt es hier Server mit Intel Xeon E5 v3 und Xeon E5 v4 Prozessoren. Kann man die beide zusammen in einem HA Cluster betreiben und den EVC Mode einfach auf „Hasswell“ stellen. Die Antwort dürfte theoretisch ja sein. Die Frage ist sollte man das auch in der Praxis tun? Es werden sehr oft VMs im Cluster migriert und kann es dann theoretisch Probleme geben wenn ständig VMs von einem Host mit einem Xeon E5 v3 Prozessor auf einem Xeon E5 v4 Host migriert werden und umgedreht?

2) Als externer Storage kommt iSCSI mit 10GBase-T zum Einsatz. Falls eine Netzwerkkarte ausfallen sollte ist ein Failover mit den 1000 Mbit onboard nics geplant. Reicht es dafür aus einfach einen neuen vSwitch zu erstellen und die 1000 Mbit failover nic mit IP vlan usw. zuzuweisen und dann läuft das failover automatisch über die 1000 Mbit nic falls die Netzwerkkarte mit den primären 10GBase-T Ports ausfällt? Dann müsste man also nur den 2. Failover vSwitch bei dem iSCSI Software Storage adapter hinzufügen? Wie definiert man dort, dass der Traffic primär über die 10Gbase-T Ports laufen soll damit die 1Gbase-T Ports nur beim Ausfall der 10Gbase-T Ports zum Einsatz kommen?

3) Internetanbindung: Ist es notwendig, dass das vCenter oder die ESXi Hosts eine aktive Internetverbindung benötigen? Bei Windows Servern ist dies ja z.B. notwendig um die Lizenzen zu aktivieren oder Windows Updates zu bekommen. Hintergrund ist, dass die Vorgabe hier lautet die vSphere Management Umgebung (vCenter, ESXi Hosts) in einem isolierten vlan ohne Internetverbindung zu betreiben. Also benötigt das vCenter/ESXi Nodes eine aktive Internetverbindung um z.B. die Lizenzen zu überpüfen bzw. auf dem Host/vCenter zu aktivieren? Oder wird dafür keine aktive Internetverbindung benötigt? Nach meinen Tests vermute ich, dass keine aktive Internetverbindung benötigt wird?

4) Bei ein paar Servern werden noch 10GBase-T Nics benötigt. Zur Auswahl stehen folgende kompatible Modelle: Intel Ethernet X540 DP 10GBASE-T Server Adapter oder QLogic 57810 Dual Port 10Gb Base-T Network Adapter. Gibt es da eine Empfehlung ob die QLogic oder Intel in der „Praxis“ besser ist? Auf der HCL scheint beides zertifiziert zu sein.

Über ein paar Antworten würde ich mich sehr freuen.

Viele Grüße

Christopher

Hallo,

ich kann dir zumindest Frage 3 Beantworten, nein braucht keinen Internetanschluss, Windows benötigst du durch die Vcenter Appliance sowieso nicht

zur Migration:

Es kann wenn es sich um Windows Vms handelt können sich hierbei LizenzProbleme ergeben sodas Windows jedes mal neu Aktiviert werden muss

ich kann dir zumindest Frage 3 Beantworten, nein braucht keinen Internetanschluss, Windows benötigst du durch die Vcenter Appliance sowieso nicht

zur Migration:

Es kann wenn es sich um Windows Vms handelt können sich hierbei LizenzProbleme ergeben sodas Windows jedes mal neu Aktiviert werden muss

-

Christopher89

- Member

- Beiträge: 7

- Registriert: 07.08.2016, 13:09

Stefan.r hat geschrieben:Hallo,

ich kann dir zumindest Frage 3 Beantworten, nein braucht keinen Internetanschluss, Windows benötigst du durch die Vcenter Appliance sowieso nicht

zur Migration:

Es kann wenn es sich um Windows Vms handelt können sich hierbei LizenzProbleme ergeben sodas Windows jedes mal neu Aktiviert werden muss

Danke schon mal soweit.

Ja, es gibt einige Windows VMs. Hierbei müsste man dann damit rechnen, dass im worst case ständig die jeweilige Windows VM neu aktiviert werden muss wenn man von einem Host mit Xeon E5 v3 auf einem Host mit Xeon E5 v4 migriert? Aber technisch gibt es da keine Probleme? Also der Xeon E5 v4 hat ja z.B. einen anderen microcode, Taktrate usw. als der E5 v3 daher fällt es mir in der Praxis schwer zu verstehen, dass solche Migrationen aus technischer Sicht reibungslos gehen?

Gibt es denn eine Empfehlung ob es daher mehr Sinn macht, dass alle Hosts im Cluster exakt identische Prozessoren haben?

-

irix

- King of the Hill

- Beiträge: 13066

- Registriert: 02.08.2008, 15:06

- Wohnort: Hannover/Wuerzburg

- Kontaktdaten:

1. Ja, dank EVC kein Problem. Bei den sehr aehnlichen CPUs wird die Windows aktivierung auch bei der Verwendung von falschen Lizenzen nicht anschlagen.

2. Nein das geht so nicht. Bei iSCSI macht man 2 gleiche Ports und nichts anderes. Sofern man das Binding von VMKs an den swISCSI Adapter benoetigt gehts technisch nicht mal anders.

3. VUM will ins Internet zwecks Download von Patches. Die VCSA eigentlich auch. Beides wuerde auch einen Proxy verweden koennen.

Beide Netzwerkwerkkarten taugen in der Praxis.

Ich moechte deine Faehigkeiten nicht in Frage stellen, aber wie man sich als Firma ein Produktivcluster mit mehreren Hosts hinstellen lassen kann vom Praktikanten ist mir schleierhaft.

Gruss

Joerg

2. Nein das geht so nicht. Bei iSCSI macht man 2 gleiche Ports und nichts anderes. Sofern man das Binding von VMKs an den swISCSI Adapter benoetigt gehts technisch nicht mal anders.

3. VUM will ins Internet zwecks Download von Patches. Die VCSA eigentlich auch. Beides wuerde auch einen Proxy verweden koennen.

Beide Netzwerkwerkkarten taugen in der Praxis.

Ich moechte deine Faehigkeiten nicht in Frage stellen, aber wie man sich als Firma ein Produktivcluster mit mehreren Hosts hinstellen lassen kann vom Praktikanten ist mir schleierhaft.

Gruss

Joerg

-

irix

- King of the Hill

- Beiträge: 13066

- Registriert: 02.08.2008, 15:06

- Wohnort: Hannover/Wuerzburg

- Kontaktdaten:

Oh Meno.... je nach Windows Version und Lizenz akzeptiert das OS eine gewisse Anzahl an Aenderungen bzw. Unterschieden.

Bei vSphere wird die CPU nicht emuliert sondern durchgereicht und somit ist das fuer das OS eine Aenderung wenn der Typ ein anderer ist.

Ich habe hier einen EVC Cluster in dem so grosse Unterschiede sind das eines der vielen Windows OS nach einer Aktivierung jammert wenn es per vMotion umgezogen ist. Das OS sieht die neue CPU aber auch erst bei einem VM Neustart. Schlaegt also unter Umstaenden erst nach Wochen zu

Bei seinen Intel v3 und v4 ist das aber kein Problem.

Neben dem OS gibts aber leider auch Software welche meint einen HW Checksum bilden zu muessen und da fuehrt die kleinste Abweichung zum erloeschen der Lizenz. Der Hersteller ist da leider auch sehr Beratungsresistent.

Gruss

Joerg

Bei vSphere wird die CPU nicht emuliert sondern durchgereicht und somit ist das fuer das OS eine Aenderung wenn der Typ ein anderer ist.

Ich habe hier einen EVC Cluster in dem so grosse Unterschiede sind das eines der vielen Windows OS nach einer Aktivierung jammert wenn es per vMotion umgezogen ist. Das OS sieht die neue CPU aber auch erst bei einem VM Neustart. Schlaegt also unter Umstaenden erst nach Wochen zu

Bei seinen Intel v3 und v4 ist das aber kein Problem.

Neben dem OS gibts aber leider auch Software welche meint einen HW Checksum bilden zu muessen und da fuehrt die kleinste Abweichung zum erloeschen der Lizenz. Der Hersteller ist da leider auch sehr Beratungsresistent.

Gruss

Joerg

-

Christopher89

- Member

- Beiträge: 7

- Registriert: 07.08.2016, 13:09

Hallo irix,

Kleine Info: Das was ich hier mache ist ein Projekt für die Implementation von vSphere 6. D.h. ich darf hier eine Testumgebung aufbauen und damit ein bisschen rumspielen. Ein paar Monate später kümmern sich dann die Kollegen um die produktive Umsetzung. Mit produktiven Daten bzw. Servern und VMs habe ich nix am Hut. Aber wenn ich das Projekt hier gut umsetze ist die Chance vielleicht ganz gut, dass die Kollegen das 1:1 übernehmen

Ansonsten danke für deine Antworten.

1) Ist soweit klar.

2) Die Frage ist folgende: DIe 10GbE nics haben 2 Ports. Physikalisch ist es aber eine PCIE Karte. Somit ggf. ein SPOF. Daher war meine Idee zu den beiden 10GbE Ports pro Server noch einen 1000 Mbit Port als iSCSI zu konfigurieren und quasi als failover zu verwenden, falls die 10GbE PCIE Karte komplett ausfallen sollte. Ist das nicht möglich?!

3) VUM ist egal. Die Vorgabe ist, dass die Umgebung isoliert läuft. Die Patches können auch manuell ohne VUM eingespielt werden. Also ist keine Internetanbindung erforderlich?

Kleine Info: Das was ich hier mache ist ein Projekt für die Implementation von vSphere 6. D.h. ich darf hier eine Testumgebung aufbauen und damit ein bisschen rumspielen. Ein paar Monate später kümmern sich dann die Kollegen um die produktive Umsetzung. Mit produktiven Daten bzw. Servern und VMs habe ich nix am Hut. Aber wenn ich das Projekt hier gut umsetze ist die Chance vielleicht ganz gut, dass die Kollegen das 1:1 übernehmen

Ansonsten danke für deine Antworten.

1) Ist soweit klar.

2) Die Frage ist folgende: DIe 10GbE nics haben 2 Ports. Physikalisch ist es aber eine PCIE Karte. Somit ggf. ein SPOF. Daher war meine Idee zu den beiden 10GbE Ports pro Server noch einen 1000 Mbit Port als iSCSI zu konfigurieren und quasi als failover zu verwenden, falls die 10GbE PCIE Karte komplett ausfallen sollte. Ist das nicht möglich?!

3) VUM ist egal. Die Vorgabe ist, dass die Umgebung isoliert läuft. Die Patches können auch manuell ohne VUM eingespielt werden. Also ist keine Internetanbindung erforderlich?

-

irix

- King of the Hill

- Beiträge: 13066

- Registriert: 02.08.2008, 15:06

- Wohnort: Hannover/Wuerzburg

- Kontaktdaten:

2. Nein das ist nicht moeglich im Falle von swISCSI sowie dem VMK Bindung und VMware wuerde beide Ports auch noch gleichberechtigen.

3. Nein kein Internet benoetigt

In 8 Jahren mit iSCSI und 35 Hosts hier im Haus kann ich sagen das noch nie eine Netzwerkkarte in der Form ausgefallen ist. Dazu kommen noch unzaehlige Deployments bei Kunden.

Aber bitte nicht falsch verstehen... der Vorschlag ist immer 2 getrennte Netzwerkkarten zu nehmen und fuer iSCSI dann auch dedizierten Ports. Letzteres kann dann unter bestimmten Umstaenden nicht immer realisiert werden.

Gruss

Joerg

3. Nein kein Internet benoetigt

In 8 Jahren mit iSCSI und 35 Hosts hier im Haus kann ich sagen das noch nie eine Netzwerkkarte in der Form ausgefallen ist. Dazu kommen noch unzaehlige Deployments bei Kunden.

Aber bitte nicht falsch verstehen... der Vorschlag ist immer 2 getrennte Netzwerkkarten zu nehmen und fuer iSCSI dann auch dedizierten Ports. Letzteres kann dann unter bestimmten Umstaenden nicht immer realisiert werden.

Gruss

Joerg

-

Christopher89

- Member

- Beiträge: 7

- Registriert: 07.08.2016, 13:09

Hallo Joerg,

thx für die schnelle Antwort

Folgende Fragen ergeben sich in dem Zusammenhang noch: Ist es besser Hardware oder Software iSCSI zu nehmen? In meiner Testumgebung sehe ich bisher keine Möglichkeit Hardware iSCSI zu nehmen? Obwohl das R630 Server mit Broadcom nics sind die Hardware SCSI eigentlich können sollten. Muss man das ggf. im BIOS irgendwo aktivieren?

Ansonsten kann ich dir sagen, dass es hier aus Praxiserfahrungen in den letzten Monaten den Ausfall einer 10 GbE Netzwerkkarte gab. Der Temperatur Sensor der Nic war kaputt und hat zu hohe Temperaturen gemeldet. Daraufhin hat die Netzwerkkarte beide 10 GbE Ports deaktiviert und der Server hat komplett die Anbindung zum iSCSI Storage verloren. Daher die Idee mit einer onboard failover nic? Ist das wirklich nicht umsetzbar?

thx für die schnelle Antwort

Folgende Fragen ergeben sich in dem Zusammenhang noch: Ist es besser Hardware oder Software iSCSI zu nehmen? In meiner Testumgebung sehe ich bisher keine Möglichkeit Hardware iSCSI zu nehmen? Obwohl das R630 Server mit Broadcom nics sind die Hardware SCSI eigentlich können sollten. Muss man das ggf. im BIOS irgendwo aktivieren?

Ansonsten kann ich dir sagen, dass es hier aus Praxiserfahrungen in den letzten Monaten den Ausfall einer 10 GbE Netzwerkkarte gab. Der Temperatur Sensor der Nic war kaputt und hat zu hohe Temperaturen gemeldet. Daraufhin hat die Netzwerkkarte beide 10 GbE Ports deaktiviert und der Server hat komplett die Anbindung zum iSCSI Storage verloren. Daher die Idee mit einer onboard failover nic? Ist das wirklich nicht umsetzbar?

-

irix

- King of the Hill

- Beiträge: 13066

- Registriert: 02.08.2008, 15:06

- Wohnort: Hannover/Wuerzburg

- Kontaktdaten:

2. Ein VMK welcher gebunden werden soll kann und darf nur eine aktive VMNIC haben und keine Standby.

Die Antwort aendert sich nicht auch wenn man die Frage mehrfach wiederholt.

Frage: Was ist das fuer ein iSCSI Storage?

Was den Ausfall angeht so haette der sich mindern lassen in dem man einfach VMware HA for Components aktiviert.

Gruss

Joerg

Die Antwort aendert sich nicht auch wenn man die Frage mehrfach wiederholt.

Frage: Was ist das fuer ein iSCSI Storage?

Was den Ausfall angeht so haette der sich mindern lassen in dem man einfach VMware HA for Components aktiviert.

Gruss

Joerg

-

Christopher89

- Member

- Beiträge: 7

- Registriert: 07.08.2016, 13:09

Hallo Joerg,

das ist Dell PowerVault iSCSI Storage.

Zu 2) Ich verstehe deine Antwort. Aber man kann doch im Software iSCSI Adapter mehrere VMks hinzufügen? Aber die sind dann alle gleichberechtigt? D.h. das wäre zwar dann möglich, aber man kann nicht einen VMK als primary definieren, weil die 1 GbE nics sollten ja nur als failover fungieren. Da alle gleichberechtigt sind wäre das dann aber suboptimal? Dann lieber gleich zwei physikalisch getrennte 10 GbE nics?

Was hätte VMware HA for Components da genau tun können wenn beide Ports gleichzeitig "down" gehen?

das ist Dell PowerVault iSCSI Storage.

Zu 2) Ich verstehe deine Antwort. Aber man kann doch im Software iSCSI Adapter mehrere VMks hinzufügen? Aber die sind dann alle gleichberechtigt? D.h. das wäre zwar dann möglich, aber man kann nicht einen VMK als primary definieren, weil die 1 GbE nics sollten ja nur als failover fungieren. Da alle gleichberechtigt sind wäre das dann aber suboptimal? Dann lieber gleich zwei physikalisch getrennte 10 GbE nics?

Was hätte VMware HA for Components da genau tun können wenn beide Ports gleichzeitig "down" gehen?

-

Christopher89

- Member

- Beiträge: 7

- Registriert: 07.08.2016, 13:09

Folgende neue Frage stellt sich für mich in dem gesamten Zusammenhang noch:

Welche Variante ist performanter? Hardware iSCSI oder den Software iSCSI Adapter zu verwenden? Oder macht das keinen wirklichen Unterschied?

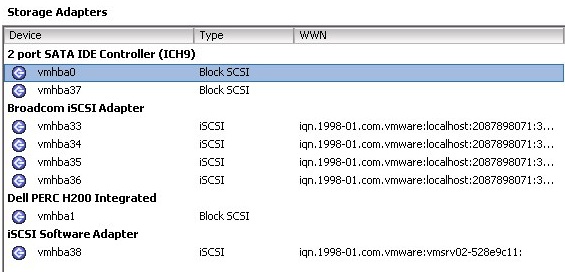

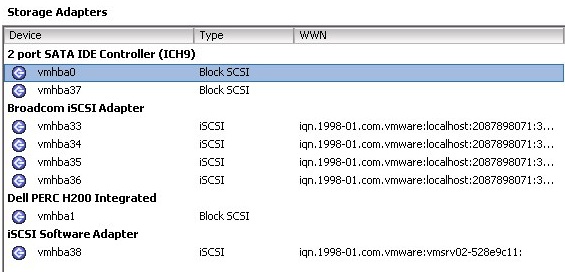

In den Servern die ich hier zum testen habe sind Broadcom 5720 nics drin. Allerdings sehe ich da keine Möglichkeit Hardware iSCSI zu konfigurieren? Das würde ich am Montag gerne mal ausprobieren so wie hier auf dem Bild:

Hat jemand von euch eine Idee was man da tun muss, damit die Broadcom Nic als Storage Controller angezeigt wird?

Welche Variante ist performanter? Hardware iSCSI oder den Software iSCSI Adapter zu verwenden? Oder macht das keinen wirklichen Unterschied?

In den Servern die ich hier zum testen habe sind Broadcom 5720 nics drin. Allerdings sehe ich da keine Möglichkeit Hardware iSCSI zu konfigurieren? Das würde ich am Montag gerne mal ausprobieren so wie hier auf dem Bild:

Hat jemand von euch eine Idee was man da tun muss, damit die Broadcom Nic als Storage Controller angezeigt wird?

-

irix

- King of the Hill

- Beiträge: 13066

- Registriert: 02.08.2008, 15:06

- Wohnort: Hannover/Wuerzburg

- Kontaktdaten:

Christopher89 hat geschrieben:Hallo Joerg,

das ist Dell PowerVault iSCSI Storage.

Zu 2) Ich verstehe deine Antwort. Aber man kann doch im Software iSCSI Adapter mehrere VMks hinzufügen? Aber die sind dann alle gleichberechtigt? D.h. das wäre zwar dann möglich, aber man kann nicht einen VMK als primary definieren, weil die 1 GbE nics sollten ja nur als failover fungieren. Da alle gleichberechtigt sind wäre das dann aber suboptimal?

Ja die sind Gleichberechtigt.

Dann lieber gleich zwei physikalisch getrennte 10 GbE nics?

Korrekt.

Was hätte VMware HA for Components da genau tun können wenn beide Ports gleichzeitig "down" gehen?

Ich sprach von "gemindert" in der Form das die VMs auf einem anderen Host neugestartet waeren.

Gruss

Joerg

-

irix

- King of the Hill

- Beiträge: 13066

- Registriert: 02.08.2008, 15:06

- Wohnort: Hannover/Wuerzburg

- Kontaktdaten:

Christopher89 hat geschrieben:

Hat jemand von euch eine Idee was man da tun muss, damit die Broadcom Nic als Storage Controller angezeigt wird?

Da werden doch schon welche gelistet. Ansonsten https://pubs.vmware.com/vsphere-50/inde ... A1F4D.html

Gruss

Joerg

-

Christopher89

- Member

- Beiträge: 7

- Registriert: 07.08.2016, 13:09

Hallo Joerg,

danke für alle deine Antworten. Hat mir schon jetzt sehr weitergeholfen.

Der Screenshot ist nicht von mir. Den habe ich ausm Netz kopiert von http://www.gabesvirtualworld.com/depend ... -on-esxi5/

Vielen Dank für den Link. Das schaue ich mir dann morgen mal genauer an

Viele Grüße

Chris

danke für alle deine Antworten. Hat mir schon jetzt sehr weitergeholfen.

Der Screenshot ist nicht von mir. Den habe ich ausm Netz kopiert von http://www.gabesvirtualworld.com/depend ... -on-esxi5/

Vielen Dank für den Link. Das schaue ich mir dann morgen mal genauer an

Viele Grüße

Chris

Wer ist online?

Mitglieder in diesem Forum: 0 Mitglieder und 3 Gäste