Die Foren-SW läuft ohne erkennbare Probleme. Sollte doch etwas nicht funktionieren, bitte gerne hier jederzeit melden und wir kümmern uns zeitnah darum. Danke!

Neue ESXi Hosts, Socket/Core/RAM Verhältnis, welche CPU?

Neue ESXi Hosts, Socket/Core/RAM Verhältnis, welche CPU?

Hallo,

mal wieder eine Planungsfrage. Wir diskutieren intern gerade mit welche Server Hardware ein neuer Cluster ausgestattet werden soll. Der Cluster soll einen unserer alten Cluster ablösen und auch neue VMs aufnehmen.

Es geht um einen alten Cluster in dem aktuell 190 VMs mit 580 vCPUs laufen, 1,8 TB von 2,5 TB vergeben sind. Die 10 Host haben 4 Sockel mit 8 oder 10 Cores (384 insgesamt). Das pCPU zu vCPU Verhältnis ist 1:1,7. Aus meiner Sicht waren im alten Cluster schon zu viele Cores im Verhältnis zum RAM vorhanden. In anderen Clustern haben wir ein Verhältnis von 1:3.

Unsere Diskussion ging zu erst in Richtung neue 4 Socket Systeme. Weil immer wieder das Gespenst Monster VMs auftaucht. Aktuell haben wir aber nicht mehr als 12 vCPUs an einer VM. 4 Socket Systeme würden aber dazu führen, das > 50 VMs auf einem Host laufen würden (Fehlerdomain). Außerdem ist das Storage bei uns auch ein Sorgenkind, da ist die Frage ob weniger Hosts am FC Storage eine gute Wahl sind.

Aus der Diskussion und dem Preis, scheinen aber entweder 2 Socket E5 Systeme mit 2 x 14C und 576 GB RAM (8 Hosts, 18x32 GB, Mem/Core 19 GB), oder 2 x 18C mit 768 GB (6 Hosts, 24x32 GB, Mem/Core 21 GB) interessant zu sein.

Mit was plant ihr eure aktuellen Cluster und warum gerade mit diesen CPUs?

mal wieder eine Planungsfrage. Wir diskutieren intern gerade mit welche Server Hardware ein neuer Cluster ausgestattet werden soll. Der Cluster soll einen unserer alten Cluster ablösen und auch neue VMs aufnehmen.

Es geht um einen alten Cluster in dem aktuell 190 VMs mit 580 vCPUs laufen, 1,8 TB von 2,5 TB vergeben sind. Die 10 Host haben 4 Sockel mit 8 oder 10 Cores (384 insgesamt). Das pCPU zu vCPU Verhältnis ist 1:1,7. Aus meiner Sicht waren im alten Cluster schon zu viele Cores im Verhältnis zum RAM vorhanden. In anderen Clustern haben wir ein Verhältnis von 1:3.

Unsere Diskussion ging zu erst in Richtung neue 4 Socket Systeme. Weil immer wieder das Gespenst Monster VMs auftaucht. Aktuell haben wir aber nicht mehr als 12 vCPUs an einer VM. 4 Socket Systeme würden aber dazu führen, das > 50 VMs auf einem Host laufen würden (Fehlerdomain). Außerdem ist das Storage bei uns auch ein Sorgenkind, da ist die Frage ob weniger Hosts am FC Storage eine gute Wahl sind.

Aus der Diskussion und dem Preis, scheinen aber entweder 2 Socket E5 Systeme mit 2 x 14C und 576 GB RAM (8 Hosts, 18x32 GB, Mem/Core 19 GB), oder 2 x 18C mit 768 GB (6 Hosts, 24x32 GB, Mem/Core 21 GB) interessant zu sein.

Mit was plant ihr eure aktuellen Cluster und warum gerade mit diesen CPUs?

-

irix

- King of the Hill

- Beiträge: 13063

- Registriert: 02.08.2008, 15:06

- Wohnort: Hannover/Wuerzburg

- Kontaktdaten:

Da ich unterwegs bin nur Kurz,

aktuell haben die Intel CPUs 4 Speicherkanaelte so das pro CPU 4 bzw. 8 Speicher Module gewaehlt werden und die letzte Bank bleibt leer wegen der Reduzierung des Taktes welche man sich einhandeln wuerde. Das sind also 128 GB pro CPU bzw. 256GB in einer 2 Sockel Kiste. Da die 32 GB Module fast auf den Preis von 2x16 plus kleiner Aufschlag geruscht sind wuerde man auch 512GB in eine 2 Sockel Kiste kriegen.

Allerdings wuerde ich die mit meiner Durchschnittlichen Memory Konfig pro VM nicht auslasten da die Anzahl an VMs auf dem Host bzw. bei 1,2 oder max. 4vCPU pro VM da ehrer der Bottleneck ist. Also ein Host hat unwahrscheinlich 576GB.

Den Punkt mit den Faultdomains finde ich sehr wichtig. Das die Serverhardware selber das Problem ist sehe ich allerdings extrem selten. Wenn dann ist immer ein Storageproblem der Ausloeser welches den Host aus dem Tritt bringt und oftmals hilt dann nur nen Reboot mit dem Abschiessen von VMs durch eintreten von HA.

vCPU Monster VMs hab ich nicht aber ich hab 2 VMs mit 128GB Memory und die bringen ein extremes Ungleichgewicht bei den Hosts welche "nur" 256GB haben.

Ich habe 150 lfd. VMs auf 10 Dual Sockel (6,8 und 12C) Hosts mit 1950GB pRAM. Die VMs haben 221 vCPUs aktuell.

Wie bewertest du bei euch die Portkosten was Anschluss an 10GbE sowie FC angeht?

Gruss

Joerg

aktuell haben die Intel CPUs 4 Speicherkanaelte so das pro CPU 4 bzw. 8 Speicher Module gewaehlt werden und die letzte Bank bleibt leer wegen der Reduzierung des Taktes welche man sich einhandeln wuerde. Das sind also 128 GB pro CPU bzw. 256GB in einer 2 Sockel Kiste. Da die 32 GB Module fast auf den Preis von 2x16 plus kleiner Aufschlag geruscht sind wuerde man auch 512GB in eine 2 Sockel Kiste kriegen.

Allerdings wuerde ich die mit meiner Durchschnittlichen Memory Konfig pro VM nicht auslasten da die Anzahl an VMs auf dem Host bzw. bei 1,2 oder max. 4vCPU pro VM da ehrer der Bottleneck ist. Also ein Host hat unwahrscheinlich 576GB.

Den Punkt mit den Faultdomains finde ich sehr wichtig. Das die Serverhardware selber das Problem ist sehe ich allerdings extrem selten. Wenn dann ist immer ein Storageproblem der Ausloeser welches den Host aus dem Tritt bringt und oftmals hilt dann nur nen Reboot mit dem Abschiessen von VMs durch eintreten von HA.

vCPU Monster VMs hab ich nicht aber ich hab 2 VMs mit 128GB Memory und die bringen ein extremes Ungleichgewicht bei den Hosts welche "nur" 256GB haben.

Ich habe 150 lfd. VMs auf 10 Dual Sockel (6,8 und 12C) Hosts mit 1950GB pRAM. Die VMs haben 221 vCPUs aktuell.

Wie bewertest du bei euch die Portkosten was Anschluss an 10GbE sowie FC angeht?

Gruss

Joerg

Viele Kerne führen häufig zu einem niedrigen Takt, und der kann mitunter ein Problem sein. Also werft einen Blick auf eure Anwendungen und prüft, in welcher Form deren Leistung vom Takt abhängt (single-thread Performance).

Ansonten bin ich immer noch ein Freund von Dual-Socket Maschinen. Mehr als 512 GB RAM macht in den Kisten wenig Sinn, da sind wir schon beim angesprochenen Thema Failure Domain.

Was Portkosten angeht: Mittlerweile auch eher vernachlässigbar. Das teure an einem 10 GbE Port ist weniger das Modul, als viel mehr der Transceiver. Das lässt sich natürlich mit DAC Kabeln lösen. Und in den meisten Fällen kommt man mit 7 bis 15m aus. Bei den FC Ports ist das natürlich so eine Sache. Erfahrungsgemäß lastet kaum ein Kunde im Tagesbetrieb (vom Backup mal abgesehen) einen 8 Gb FC Port aus. Die kleinsten Switches im Markt sind 8 Port, meistens 8 Ports aktiv, 16 Ports vorhanden. Das liegt i.d.R. deutlich unter den Größen der Cluster. Sollte also eher selten ein Problem sein.

Ansonten bin ich immer noch ein Freund von Dual-Socket Maschinen. Mehr als 512 GB RAM macht in den Kisten wenig Sinn, da sind wir schon beim angesprochenen Thema Failure Domain.

Was Portkosten angeht: Mittlerweile auch eher vernachlässigbar. Das teure an einem 10 GbE Port ist weniger das Modul, als viel mehr der Transceiver. Das lässt sich natürlich mit DAC Kabeln lösen. Und in den meisten Fällen kommt man mit 7 bis 15m aus. Bei den FC Ports ist das natürlich so eine Sache. Erfahrungsgemäß lastet kaum ein Kunde im Tagesbetrieb (vom Backup mal abgesehen) einen 8 Gb FC Port aus. Die kleinsten Switches im Markt sind 8 Port, meistens 8 Ports aktiv, 16 Ports vorhanden. Das liegt i.d.R. deutlich unter den Größen der Cluster. Sollte also eher selten ein Problem sein.

Wir haben bei der Planung die Reduzierung des Takts noch nicht berücksichtigt. Bisher haben wir nur naiv geschaut, was wir je 2 Sockel Host max. konfigurieren können. Am attraktivsten erscheint unter dem Performance Punk bzgl RAM die Kombination 2 x 14C und 16 x 32 GB RAM. Damit liegen wir bei 8 Hosts und 224 Cores / 4096 GB RAM. Das ergibt 18 GB/ Core. Es handelt sich um stretch cluster, bisher beachten wir dort auch nur, dass wir 50% der vRAM Ressourcen als Reserve lassen. Ich bin noch unschlüssig, wie kritisch der Wegfall von 50% Cores in einem Desaster ist. Aktuell rechne ich bei pCPU:vCPU mit 1:3. Im Desaster wären das dann 1:6. Das ist laut alten Empfehlungen von VMware schon an der Grenze.

Die Portkosten und Lizenzkosten/Socket beachten wir bisher auch nicht. Da MS schon auf Cores statt Sockets geht, erwarten wir dort bei anderen Herstellern auch einen Schwenk.

Die Portkosten und Lizenzkosten/Socket beachten wir bisher auch nicht. Da MS schon auf Cores statt Sockets geht, erwarten wir dort bei anderen Herstellern auch einen Schwenk.

-

irix

- King of the Hill

- Beiträge: 13063

- Registriert: 02.08.2008, 15:06

- Wohnort: Hannover/Wuerzburg

- Kontaktdaten:

Also DAC Kabel mit mehr als 7m sind mir noch nicht untergekommen des weiteren supporten das die Hersteller nur wenn "alles" aus einer Hand kommt. Sobald davon abweicht kommt auch von den Cancoms/Comuputer Center dieser Welt die Empfehlung Gbics/LWL zunehmen.

Wir haben keine Problem solange es im Rack bleibt und wir koennen mit den 6/7m auch noch ein Rack daneben anschliessen.

Aber da wo ich groessere Kunden habe stellt sich die Frage nach DAC selten oftmals "Strukturiere Verkabelung" gelebt wurde bzw. es nen zentralen Core Switch gibt und der steht manchmal weiter weg.

Aber das Thema driftet nun ab.

Gruss

Joerg

Wir haben keine Problem solange es im Rack bleibt und wir koennen mit den 6/7m auch noch ein Rack daneben anschliessen.

Aber da wo ich groessere Kunden habe stellt sich die Frage nach DAC selten oftmals "Strukturiere Verkabelung" gelebt wurde bzw. es nen zentralen Core Switch gibt und der steht manchmal weiter weg.

Aber das Thema driftet nun ab.

Gruss

Joerg

Moin!

Wir haben jetzt 6 Stück x3650 M5 mit 2x 18 Cores und 512GB (mit vollen 2133 MHz Speichertakt) verbaut.

Trotz etwas niedrigerem Prozessortakt (2.4GHz) als die Vorgänger (2.9GHz, aber ältere Prozessorgeneration), laufen die VMs wie die berühmte Schmitz Katze

Angebunden per 2x 16GB FC (Switch nur 8GB ) und 2x 10G LWL Management / vMotion und 2x 10G LWL VM-Traffic.

) und 2x 10G LWL Management / vMotion und 2x 10G LWL VM-Traffic.

Ein Bekannter hatte schon massive Probleme mit DAC Kabeln und hat die wieder rausgeschmissen... Deckt sich auch mir der Erfahrung eines DL, der uns manchmal unterstützt.

Ebenfalls haben wir noch mehrere 4 Sockel Server mit 1TB Speicher im Einsatz. Ob die beim nächsten Austausch in 2 Sockel Maschinen getauscht werden, muss ich nochmal überlegen. Deswegen ist die Diskussion sehr interessant hier

Wir haben jetzt 6 Stück x3650 M5 mit 2x 18 Cores und 512GB (mit vollen 2133 MHz Speichertakt) verbaut.

Trotz etwas niedrigerem Prozessortakt (2.4GHz) als die Vorgänger (2.9GHz, aber ältere Prozessorgeneration), laufen die VMs wie die berühmte Schmitz Katze

Angebunden per 2x 16GB FC (Switch nur 8GB

Ein Bekannter hatte schon massive Probleme mit DAC Kabeln und hat die wieder rausgeschmissen... Deckt sich auch mir der Erfahrung eines DL, der uns manchmal unterstützt.

Ebenfalls haben wir noch mehrere 4 Sockel Server mit 1TB Speicher im Einsatz. Ob die beim nächsten Austausch in 2 Sockel Maschinen getauscht werden, muss ich nochmal überlegen. Deswegen ist die Diskussion sehr interessant hier

irix hat geschrieben:Also DAC Kabel mit mehr als 7m sind mir noch nicht untergekommen des weiteren supporten das die Hersteller nur wenn "alles" aus einer Hand kommt. Sobald davon abweicht kommt auch von den Cancoms/Comuputer Center dieser Welt die Empfehlung Gics/LWL zunehmen.

Bei unterschiedlichen Herstellern stimmt das, da kommt man i.d.R. um Transceiver nicht herum. Aber aktive DAC Kabel mit 10 und 15m gibt es, u.a. von HP und ein paar anderen Herstellern.

-

irix

- King of the Hill

- Beiträge: 13063

- Registriert: 02.08.2008, 15:06

- Wohnort: Hannover/Wuerzburg

- Kontaktdaten:

bla!zilla hat geschrieben:irix hat geschrieben:Also DAC Kabel mit mehr als 7m sind mir noch nicht untergekommen des weiteren supporten das die Hersteller nur wenn "alles" aus einer Hand kommt. Sobald davon abweicht kommt auch von den Cancoms/Comuputer Center dieser Welt die Empfehlung Gics/LWL zunehmen.

Bei unterschiedlichen Herstellern stimmt das, da kommt man i.d.R. um Transceiver nicht herum. Aber aktive DAC Kabel mit 10 und 15m gibt es, u.a. von HP und ein paar anderen Herstellern.

Ah das erklaerts. Weil es gibt auch passive und nur die sind hier biem Haus und Hof Storage supportet und drum "sehe" ich nur diese hier.

Zum Thema Lizenzierung und Cores. Bei VMware ist ja dieser Testballon damals geplatzt und auch Veeam hats wieder auf Sockel geaendert. Leider vermute ich das Microsoft mehr Marktmacht und ein dickeres Fell hat und Kunden Mangels alternative nicht wechseln koennen. Was hatten die geplant fuer Server 2016? Es werden 8 Core lizenziert und dann kann man in 2er Schritten nachkaufen sein Windows Datacenter?

Gruss

Joerg

Das mit den 2 DIMMs pro Channel um die volle Taktrate zu erhalten ist blöd. Mit 512 GB ist das schon wieder knapp. Aktuell haben unsere VMs im Durchschnitt 10 GB vRAM. Wenn ich einen Cluster plane mit 10 x 14C*2 komme ich auf 280 Cores und 5120 GB RAM. Wenn ich 50% Reserve wegen des Stretch Clusters rechne, komme ich auf 256 VMs in dem Cluster. Wenn ich über die Cores rechne, also z.B. mit pCPU:vCPU von 1:3 und 3 vCPUs/VM, dann kommt ich auf "nur" (280 Cores * 3 / 3 / 2) 140 VMs.

-

irix

- King of the Hill

- Beiträge: 13063

- Registriert: 02.08.2008, 15:06

- Wohnort: Hannover/Wuerzburg

- Kontaktdaten:

Aendern sich die Zahlen stark wenn du mal nur 95% annimmst und so die Ausreisser mal ausvorlaesst?

Aktuell sehe ich die 2.4Ghz CPUs so als untere Grenze was den Takt angeht fuer die Workload welche meine Kunden so haben. Die welche Kleiner sind bzw. weniger VMs haben da sinds bedienen sich gerne bei der 3.1Ghz Variante. Das Thema SingleThreaded Performance was Blazilla da angesprochen hat ist nicht zu unterscherschaetzen.

Wenn das Storage Bauchschmerzen macht halt eine Caching-Loesung im Host.

Wenn die Reduzierung der Speichertaktrate nicht hingenommen werden kann bzw. das Verhaeltniss von pCore zu vCore nicht mehr passt dann muss halt die Anzahl der Hosts erhoeht werden. Hilft ja nun kein grosses rumreden.

Gruss

Joerg

Aktuell sehe ich die 2.4Ghz CPUs so als untere Grenze was den Takt angeht fuer die Workload welche meine Kunden so haben. Die welche Kleiner sind bzw. weniger VMs haben da sinds bedienen sich gerne bei der 3.1Ghz Variante. Das Thema SingleThreaded Performance was Blazilla da angesprochen hat ist nicht zu unterscherschaetzen.

Wenn das Storage Bauchschmerzen macht halt eine Caching-Loesung im Host.

Wenn die Reduzierung der Speichertaktrate nicht hingenommen werden kann bzw. das Verhaeltniss von pCore zu vCore nicht mehr passt dann muss halt die Anzahl der Hosts erhoeht werden. Hilft ja nun kein grosses rumreden.

Gruss

Joerg

Sehe ich auch so. 2,3, 2,4, 2,6 GHz sind die Taktraten die ich derzeit am häufigsten verwurste. Höherer Takt ist meist nur durch geringere Kernanzahl zu erkaufen. Zudem gibt es noch viele X5600 CPUs mit Taktraten von 2,5 bis 3,0 GHz da draußen. Da kann es schnell nach hinten losgehen, wenn man dann mit 1,8 oder 2,0 GHz um die Ecke kommt.

-

Dayworker

- King of the Hill

- Beiträge: 13657

- Registriert: 01.10.2008, 12:54

- Wohnort: laut USV-Log am Ende der Welt...

Der Server fällt echt direkt um zwei Bins runter, wenn man 3 DIMMs pro Channel belegt?pirx hat geschrieben:Der Frequenz sinkt von 2133 MHz auf 1600 MHz. Ich denke das ist schon spürbar.

Ich habe mir mal exemplarisch das Datenblatt zum Dell PowerEdge R630 gezogen und da mal zur Seite 21 geblättert. Mit 3 DIMMs sinkt die Höchstfrequenz grade mal um ein Bin auf 1866 anstatt 2133. Das sehe ich nicht wirklich als Engpaß an, kann natürlich auf anderen Maschinen schon ganz anders aussehen.

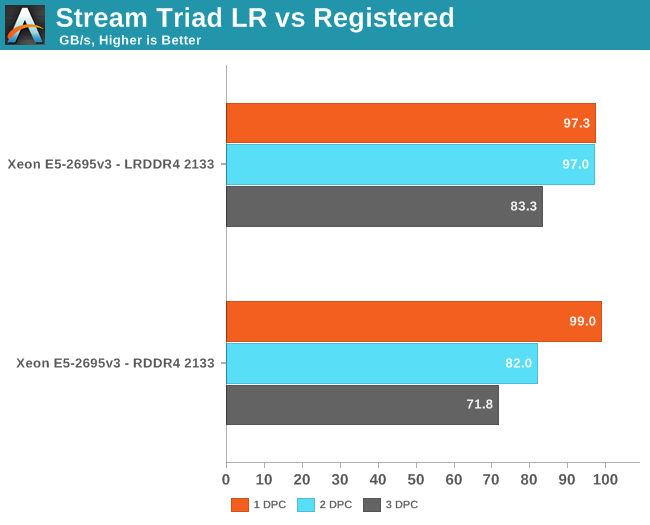

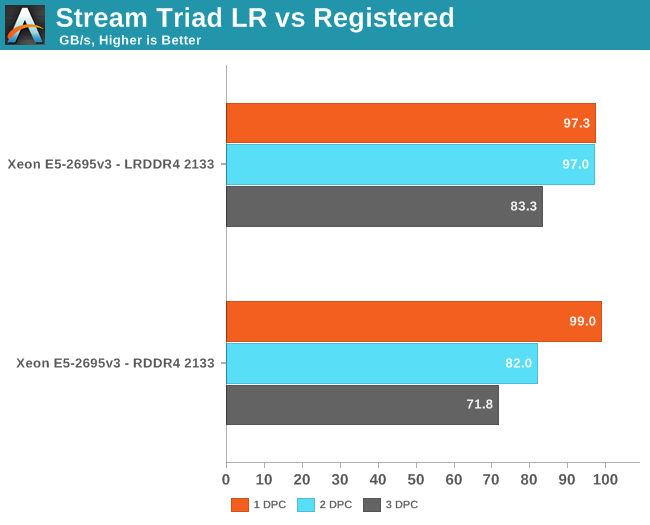

Es gibt auch einige Artikel zum Thema Speicherperforamance. Man landet am Ende bei den 30% Abschlag.

http://frankdenneman.nl/2015/02/25/memo ... dive-ddr4/

http://frankdenneman.nl/wp-content/uplo ... h-test.png

http://frankdenneman.nl/2015/02/25/memo ... dive-ddr4/

http://frankdenneman.nl/wp-content/uplo ... h-test.png

-

Dayworker

- King of the Hill

- Beiträge: 13657

- Registriert: 01.10.2008, 12:54

- Wohnort: laut USV-Log am Ende der Welt...

Falls du kein normaler RDDR4, sondern wegen der Verbrauchsvorteile und weil LRDDR4 nur bei 32GB-Modulen und grösser überhaupt Sinn macht, einsetzt, sind es nur ~15 Prozent bei 3 DPC.

Mit einfachem RDDR4 dagegen fällt die mögliche DIMM-Geschwindigkeit bereits ab 2 DPC um diese ~15 Prozent auf 1866 und mit 3 DPC dann um weitere ~15 Prozent auf 1600 zurück. Das ist aber immer noch besser, als was zu Tripple-Channel-Zeiten mit 50 Prozent Geschwindigkeitsverlust zu ertragen war und von ertragen mußte man da wirklich sprechen. Anstatt 1600 waren dann nur noch lahme 800 möglich.

Du willst doch möglichst viel RAM verbauen. Von daher wirst du doch sowieso 32GB-Riegel einsetzen und vom RTI sprich Preispunkt machen LR-DIMMs nur in dieser Grösse einen Sinn. Bei 16GB-DIMMs war zumindest zu DDR3-Zeiten der Aufpreis für LR-DIMMs nicht zu rechtfertigen, denn die verbrieften Verbrauchseinsparungen konnten den Aufpreis niemals aufwiegen und deutlich anders wird es jetzt auch mit DDR4 nicht sein. Von der Warte läufts in meinen Augen auf 32GB-Riegel als LR-DDR4 und nur ~15 Prozent Geschwindigkeitsverlust bei 3 DPC raus, falls das Problem Failure Domain lösbar ist.

Mit einfachem RDDR4 dagegen fällt die mögliche DIMM-Geschwindigkeit bereits ab 2 DPC um diese ~15 Prozent auf 1866 und mit 3 DPC dann um weitere ~15 Prozent auf 1600 zurück. Das ist aber immer noch besser, als was zu Tripple-Channel-Zeiten mit 50 Prozent Geschwindigkeitsverlust zu ertragen war und von ertragen mußte man da wirklich sprechen. Anstatt 1600 waren dann nur noch lahme 800 möglich.

Du willst doch möglichst viel RAM verbauen. Von daher wirst du doch sowieso 32GB-Riegel einsetzen und vom RTI sprich Preispunkt machen LR-DIMMs nur in dieser Grösse einen Sinn. Bei 16GB-DIMMs war zumindest zu DDR3-Zeiten der Aufpreis für LR-DIMMs nicht zu rechtfertigen, denn die verbrieften Verbrauchseinsparungen konnten den Aufpreis niemals aufwiegen und deutlich anders wird es jetzt auch mit DDR4 nicht sein. Von der Warte läufts in meinen Augen auf 32GB-Riegel als LR-DDR4 und nur ~15 Prozent Geschwindigkeitsverlust bei 3 DPC raus, falls das Problem Failure Domain lösbar ist.

Wo siehst du 15%?, ich sehe überall den Fall von 2133 auf 1600 bei 3DPC und 32 GB LRDIMMs. Bei 2DPC (16x32=512) ist die Frequenz noch 2133, bei 768 GB eben 1/3 geringer.

http://frankdenneman.nl/wp-content/uplo ... ations.png

http://frankdenneman.nl/wp-content/uplo ... ations.png

-

Dayworker

- King of the Hill

- Beiträge: 13657

- Registriert: 01.10.2008, 12:54

- Wohnort: laut USV-Log am Ende der Welt...

Dein letztes Bild soll den angeblichen Downclock zeigen. Wenn man sich jedoch den Text durchliest, sieht man die erstaunte Feststellung des Authors, daß der Downclock bei 3 DPC nur auf 1866 geht und nicht wie von Intel spezifiert auf 1600. Von daher ist die Abbildung 1 deines letzten Links anscheinend nicht korrekt und sollte eher folgendem entsprechen:

Wenn ich mir die Durchsätze des dortigen "E5-2695v3 - LRDDR4 2133" ansehe, erreicht dieser auch mit 2DPC noch 97GB/s und bricht erst mit 3DPC auf 83.3GB/s ein. Diese 14 Prozent entsprechen, wenn ich mich nicht wieder mal verrechnet habe, auch genau einem Speedbin des Speichertaktes und somit läuft der Speicher dort noch mit 1866 Speichertakt.

Dieselbe CPU mit "RDDR4 2133" dagegen ist mit 1 DPC etwas performanter, was aufgrund etwas anderer Ansteuerung im Gegensatz zu LR-DIMMs nicht unerwartet ist, und bricht mit 2 DPC bereits auf 82GB/s ein. Warum hier bereits ein deutlich grösserer Einbruch von 17 GB/s bzw Prozent zu verzeichnen ist, dürfte einem Meßfehler geschuldet sein, denn bei 3 DPC sinkt der Durchsatz ja gerade mal um weitere 10 GB/s bzw Prozent. Das ist deutlich weniger als der rechnerische Unterschied zwischen zwei Speedbins des Speichertaktes. Unabhängig davon ist aber sichtbar, daß mit RDDR4 bereits deutlich weniger Durchsatz bei 2 DPC wie mit LR-DDR4 erreichbar ist. Wenn ich die angezeigten Durchsätze in Speedbins umrechne und den RDDR4-Ausrutscher mit 2 DPC geradeziehe, verringert sich der Durchsatz entsprechend dem Speichertakt jeweils um ~15 Prozent. Mit RDDR4 scheint es also bereits mit 2 DPC zu einer Verringerung des Speichertaktes zu kommen, während dies mit LR-DDR4 erst bei 3 DPC der Fall ist.

Hoffentlich versteht das jetzt noch wer...

Wenn ich mir die Durchsätze des dortigen "E5-2695v3 - LRDDR4 2133" ansehe, erreicht dieser auch mit 2DPC noch 97GB/s und bricht erst mit 3DPC auf 83.3GB/s ein. Diese 14 Prozent entsprechen, wenn ich mich nicht wieder mal verrechnet habe, auch genau einem Speedbin des Speichertaktes und somit läuft der Speicher dort noch mit 1866 Speichertakt.

Dieselbe CPU mit "RDDR4 2133" dagegen ist mit 1 DPC etwas performanter, was aufgrund etwas anderer Ansteuerung im Gegensatz zu LR-DIMMs nicht unerwartet ist, und bricht mit 2 DPC bereits auf 82GB/s ein. Warum hier bereits ein deutlich grösserer Einbruch von 17 GB/s bzw Prozent zu verzeichnen ist, dürfte einem Meßfehler geschuldet sein, denn bei 3 DPC sinkt der Durchsatz ja gerade mal um weitere 10 GB/s bzw Prozent. Das ist deutlich weniger als der rechnerische Unterschied zwischen zwei Speedbins des Speichertaktes. Unabhängig davon ist aber sichtbar, daß mit RDDR4 bereits deutlich weniger Durchsatz bei 2 DPC wie mit LR-DDR4 erreichbar ist. Wenn ich die angezeigten Durchsätze in Speedbins umrechne und den RDDR4-Ausrutscher mit 2 DPC geradeziehe, verringert sich der Durchsatz entsprechend dem Speichertakt jeweils um ~15 Prozent. Mit RDDR4 scheint es also bereits mit 2 DPC zu einer Verringerung des Speichertaktes zu kommen, während dies mit LR-DDR4 erst bei 3 DPC der Fall ist.

Hoffentlich versteht das jetzt noch wer...

Ich denke die 1833 MHz bei 3DPC gelten nur für DIMMs von bestimmten Herstellern. Bei HP gibt es Smart Memory, das auch do spezifiziert ist, bei Dell glaube ich auch. Bei Fujitsu habe ich nur die Werte von Intel gefunden. Und da wir aktuell Fujitsu kaufen, muss ich mit diesem Wert rechnen.

http://sp.ts.fujitsu.com/dmsp/Publicati ... -ww-de.pdf

http://sp.ts.fujitsu.com/dmsp/Publicati ... -ww-de.pdf

hi,

ich beschäftige mich auch gerade mit den Thema Speicheranbindung/Geschwindigkeit im Kontext von möglichen bottleneks bei uns.

PE R720 mit 2x E5-2620 und 16 x16GB Ram Modulen DDR3-1333 RDIMM

Wie frage ich denn den den aktuellen Ram Speed eines Hosts ab?

die Commands aus der 4er Version von ESX funktionieren ned mehr -.-

Grüße

ich beschäftige mich auch gerade mit den Thema Speicheranbindung/Geschwindigkeit im Kontext von möglichen bottleneks bei uns.

PE R720 mit 2x E5-2620 und 16 x16GB Ram Modulen DDR3-1333 RDIMM

Wie frage ich denn den den aktuellen Ram Speed eines Hosts ab?

die Commands aus der 4er Version von ESX funktionieren ned mehr -.-

Grüße

ReedyTT hat geschrieben:hi,

PE R720 mit 2x E5-2620 und 16 x16GB Ram Modulen DDR3-1333 RDIMM

Grüße

https://www.dell.com/downloads/global/p ... memory.pdf

sollte schon mit 1333Mhz laufen, der PE720 ist da direkt als Beispiel mit 256GB Ram drin.

-

irix

- King of the Hill

- Beiträge: 13063

- Registriert: 02.08.2008, 15:06

- Wohnort: Hannover/Wuerzburg

- Kontaktdaten:

Als das mit den Taktgeschgewindigkeiten so aufkam zu Nehalem Zeiten gabs gleich welche (Cisco) laut getrommelt haben das sie da "besser" sind, sprich fuer die ersten beiden Baenke die volle Geschwindigkeiten halten koennen.

Ich weis das es bei unseren alten Fujitsu TX300 so war das die das es per BIOS Update nachgereicht wurde.

Da sich Intel v4 ja am Horizont ankuendigt die Frage ob sich da was aendert. Zumind. hier in den Unterlagen ist nix zusehen und es bleibt bei den 4 Speicherkanaelen. Die Flut an Neuerungen kommt dann mit der v5. Gesagtes meine ich was die E5-2600er angeht weil bei anderen zaehlt die Generation ein wenig anders.

Gruss

Joerg

Ich weis das es bei unseren alten Fujitsu TX300 so war das die das es per BIOS Update nachgereicht wurde.

Da sich Intel v4 ja am Horizont ankuendigt die Frage ob sich da was aendert. Zumind. hier in den Unterlagen ist nix zusehen und es bleibt bei den 4 Speicherkanaelen. Die Flut an Neuerungen kommt dann mit der v5. Gesagtes meine ich was die E5-2600er angeht weil bei anderen zaehlt die Generation ein wenig anders.

Gruss

Joerg

-

irix

- King of the Hill

- Beiträge: 13063

- Registriert: 02.08.2008, 15:06

- Wohnort: Hannover/Wuerzburg

- Kontaktdaten:

ReedyTT hat geschrieben:PE R720 mit 2x E5-2620 und 16 x16GB Ram Modulen DDR3-1333 RDIMM

Wie frage ich denn den den aktuellen Ram Speed eines Hosts ab?

Pragmatisch wuerde ich beim naechsten Boot einfach mal hinzugucken weil er zeigt Speichermenge und Geschwindigkeit an. Eine iDRAC zeichnet die letzten (problem?) Bootvorgaenge auf und du koenntest schauen obs nen Video zum angcken gibt weil dann muss man nicht rebooten.

Ein OMIVV zeigt zwar Hersteller und Seriennummer des DIMMs an aber nicht die Geschwindigkeit.

Der vSphere WebClient zeigt aber unter Hardware Status - Memory die Informationen des DIMMs an. Die Frage ist nun welcher Wert angezeigt wird, sprich den mit welchem das DIMM spezifiziert ist oder dem welchen es aktuell hat.

Gruss

Joerg

Da kann ich anmerken, dass die HW-Info im Client die max. spezifierte Geschwindigkeit (der Kombi DIMM/Mainboard?) anzeigt, und definitiv NICHT die aktuelle.

Der Hinweis iDRAC/iLO/iRMC/whatever ist hier bestimmt 'ne gute Idee (da habe zumindest ich das vorhin mal geprueft). Ich vermute mal, dass die Aussage "unter ESX 4 ging's" tatsaechlich auf ESX (und nicht ESXi) abzielte, weil da in der ServiceConsole ggfs. entsprechende HW-Agenten installiert waren, die diese Info aus den jeweiligen Management-Chips auslesen konnten.

Der Hinweis iDRAC/iLO/iRMC/whatever ist hier bestimmt 'ne gute Idee (da habe zumindest ich das vorhin mal geprueft). Ich vermute mal, dass die Aussage "unter ESX 4 ging's" tatsaechlich auf ESX (und nicht ESXi) abzielte, weil da in der ServiceConsole ggfs. entsprechende HW-Agenten installiert waren, die diese Info aus den jeweiligen Management-Chips auslesen konnten.

Wer ist online?

Mitglieder in diesem Forum: 0 Mitglieder und 7 Gäste